Pubblicato inruminazioni

I bizzarri limiti di Outlook per Windows

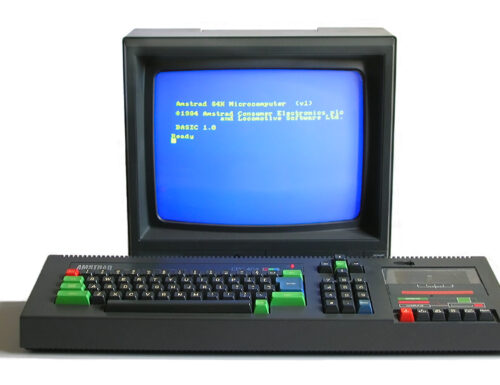

Sono ormai molti anni che ho a che fare con l’informatica (come potreste agilmente verificare raspando indietro in…

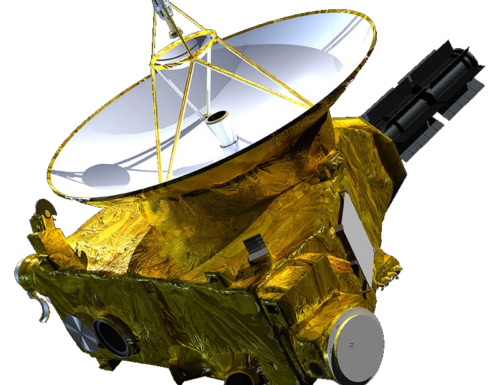

Avventure di un astrofisico (ed altri) in mezzo ai bit

Tema Seamless René, sviluppato da Altervista

Apri un sito e guadagna con Altervista - Disclaimer - Segnala abuso - Privacy Policy - Personalizza tracciamento pubblicitario